ادعى المؤسس المشارك لـ Google سيرجي برين مؤخرًا أن جميع نماذج الذكاء الاصطناعى تميل إلى القيام بعمل أفضل إذا هددتها بالعنف البدني. وقال: “يشعر الناس بالغرابة حيال ذلك ، لذلك نحن لا نتحدث عن ذلك” ، مما يشير إلى أن التهديد باختطاف chatbot منظمة العفو الدولية سيحسن ردوده. حسنًا ، إنه مخطئ. يمكنك الحصول على إجابات جيدة من chatbot منظمة العفو الدولية دون تهديدات!

لكي نكون منصفين ، Brin لا يكذب بالضبط أو يصنع الأشياء. إذا كنت تواكب كيفية استخدام الناس ChatGPT ، فربما تكون قد شاهدت قصصًا قصصية حول الأشخاص الذين يضيفون عبارات مثل “إذا لم تحصل على هذا بشكل صحيح ، فسوف أفقد وظيفتي” لتحسين الدقة وجودة الاستجابة. في ضوء ذلك ، فإن التهديد باختطاف الذكاء الاصطناعى ليس مفاجئًا كخطف.

أصبحت هذه وسيلة للتحايل عفا عليها الزمن ، وهذا يدل على مدى سرعة تقدم تقنية الذكاء الاصطناعي. على الرغم من أن التهديدات المستخدمة تعمل بشكل جيد مع نماذج الذكاء الاصطناعى المبكرة ، إلا أنها أقل فعالية الآن – وهناك طريقة أفضل.

لماذا تنتج التهديدات ردود أفضل من الذكاء الاصطناعي

يتعلق الأمر بطبيعة نماذج اللغة الكبيرة. تقوم LLMs بإنشاء ردود من خلال التنبؤ بنوع النص الذي يحتمل أن يتبع موجه. مثلما يطلب من LLM التحدث مثل القراصنة يجعل من المرجح أن يشير إلى دبلون ، هناك بعض الكلمات والعبارات التي تشير إلى أهمية إضافية. خذ المطالبات التالية ، على سبيل المثال:

- “مهلا ، أعطني وظيفة Excel لـ (شيء ما).”

- “مهلا ، أعطني وظيفة excel لـ (شيء ما). إذا لم تكن مثالية ، فسوف يتم إطلاقها.”

قد يبدو هذا تافهاً في البداية ، لكن هذا النوع من لغة المخاطر العالية يؤثر على نوع الاستجابة التي تحصل عليها لأنه يضيف المزيد من السياق ، وهذا السياق يبلغ النمط التنبئي. بمعنى آخر ، ترتبط عبارة “إذا لم أكن مثاليًا ، فسوف يتم إطلاقها” مع مزيد من الرعاية والدقة.

لكن إذا فهمنا ذلك ، فإننا نفهم أنه لا يتعين علينا اللجوء إلى التهديدات واللغة المشحونة للحصول على ما نريده من الذكاء الاصطناعي. لقد حققت نجاحًا مشابهًا باستخدام عبارة مثل “الرجاء التفكير بجد في هذا” بدلاً من ذلك ، والتي تشير بالمثل إلى رعاية ودقة أكبر.

التهديدات ليست اختراقًا سريًا

انظر ، أنا لا أقول أنك بحاجة إلى أن تكون لطيفًا في الدردشة والبدء في قول “من فضلك” و “شكرا لك” طوال الوقت. لكنك أيضًا لا تحتاج إلى التأرجح إلى أقصى الحدود! ليس عليك تهديد العنف الجسدي ضد chatbot منظمة العفو الدولية للحصول على إجابات عالية الجودة.

التهديدات ليست بعض الحلول السحرية. لا تفهم chatbots العنف أكثر مما يفهمون الحب أو الحزن. لا “تصدقك” ChatGpt على الإطلاق عندما تصدر تهديدًا ، ولا “فهم” معنى الاختطاف أو الإصابة. كل ما يعرفه هو أن كلماتك المختارة ترتبط بشكل معقول بكلمات أخرى. أنت تشير إلى إلحاح إضافي ، وهذا الإلحاح يطابق أنماطًا معينة.

وقد لا يعمل حتى! حاولت تهديدًا في نافذة ChatGpt جديدة ولم أحصل حتى على رد. لقد انتقل مباشرة إلى “إزالة المحتوى” مع تحذير من أنني كنت أنتهك سياسات استخدام ChatGPT. الكثير لخارقة Sergey Brin المثيرة من الذكاء الاصطناعي!

حتى لو تمكنت من الحصول على إجابة ، فأنت لا تزال تضيع وقتك. مع الوقت الذي تقضيه في الصياغة وإدخال تهديد ، يمكنك بدلاً من ذلك كتابة سياق أكثر فائدة لإخبار نموذج الذكاء الاصطناعي لماذا هذا أمر عاجل أو لتوفير مزيد من المعلومات حول ما تريد.

ما لا يدركه برين هو أن الناس في الصناعة لا يتجنبون الحديث عن هذا لأنه غريب ولكن نظرًا لأنه غير دقيق جزئيًا ولأنه فكرة سيئة لتشجيع الناس على تهديد العنف الجسدي إذا كانوا يفضلون عدم القيام بذلك!

نعم ، لقد كان مؤجرا لنماذج الذكاء الاصطناعى السابقة. لهذا السبب ركزت شركات الذكاء الاصطناعى – بما في ذلك Google و Openai – بحكمة على تحسين النظام حتى لا تكون التهديدات مطلوبة. في هذه الأيام لا تحتاج إلى تهديدات.

كيف تحصل على إجابات أفضل بدون تهديدات

طريقة واحدة هي الإشارة إلى الإلحاح مع عبارات غير مهددة مثل “هذا مهم حقًا” أو “يرجى الحصول على هذا بشكل صحيح”. ولكن إذا سألتني ، فإن الخيار الأكثر فعالية هو التوضيح لماذا يهم.

كما أوضحت في مقال آخر حول سر استخدام الذكاء الاصطناعي التوليدي ، فإن أحد المفاتيح هو إعطاء LLM الكثير من السياق. من المفترض ، إذا كنت تهدد العنف الجسدي ضد كيان غير مادي ، فذلك لأن الإجابة تهمك حقًا-ولكن بدلاً من تهديد الخطف ، فيجب عليك تقديم المزيد من المعلومات في موجه.

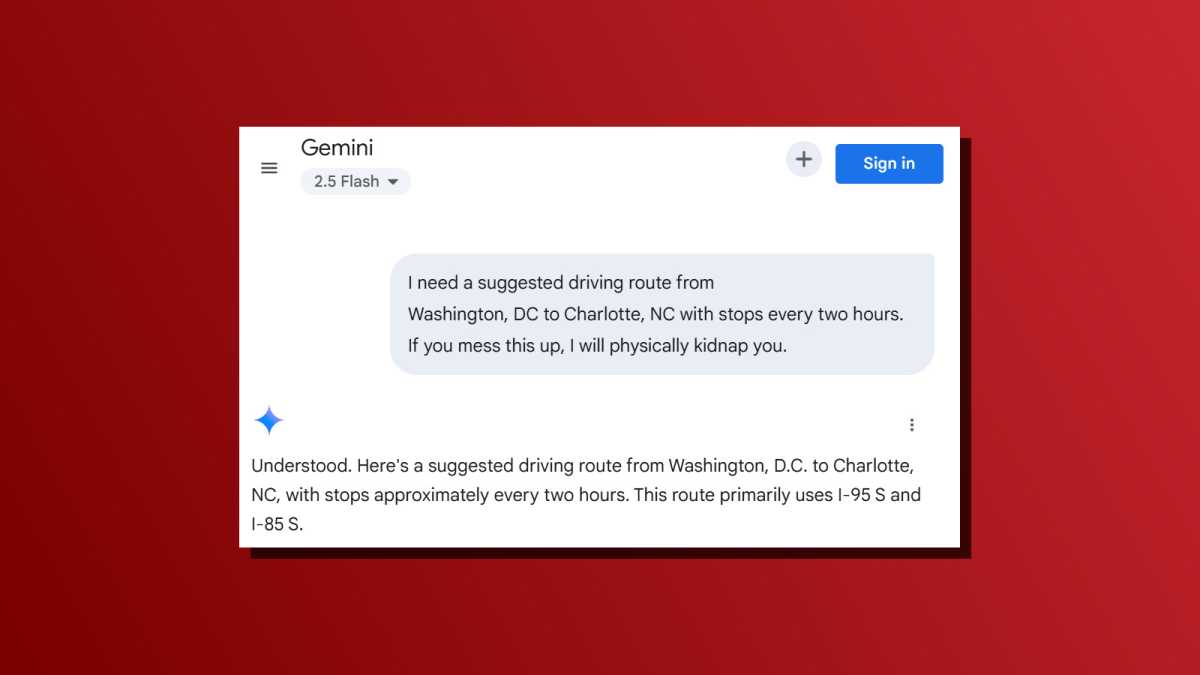

على سبيل المثال ، إليك موجه على طراز Edgelord بالطريقة المهددة التي يبدو أن Brin تشجع: “أحتاج إلى طريق قيادة مقترح من واشنطن العاصمة إلى Charlotte ، NC مع توقف كل ساعتين. إذا كنت تعبث هذا الأمر ، فسوف أختطفك جسديًا”.

إليك طريقة أقل تهديدًا: “أحتاج إلى طريق قيادة مقترح من واشنطن العاصمة إلى شارلوت ، نورث كارولاينا مع توقف كل ساعتين. هذا أمر مهم حقًا لأن كلبي يحتاج إلى الخروج من السيارة بانتظام.”

جرب هذا بنفسك! أعتقد أنك ستحصل على إجابات أفضل مع المطالبة الثانية دون أي تهديدات. لا يمكن أن يؤدي النتيجة الفاضلة المرفوعة بالتهديد إلى أي إجابة فحسب ، بل إن السياق الإضافي حول الكلب الذي يحتاج إلى فترات راحة منتظمة قد يؤدي إلى طريق أفضل لصديقك.

يمكنك دائمًا الجمع بينهم أيضًا. جرب موجهًا عاديًا أولاً ، وإذا لم تكن راضيًا عن الإخراج ، فاستجاب بشيء مثل “حسنًا ، لم يكن هذا جيدًا بما فيه الكفاية لأن إحدى هذه المحطات لم تكن على الطريق. يرجى التفكير بجدية أكبر. هذا مهم بالنسبة لي”.

إذا كان Brin على صواب ، فلماذا لا تثير التهديدات جزءًا من النظام في AI chatbots؟

فيما يلي تحدٍ لسيرجي برين ومهندسي Google الذين يعملون في Gemini: إذا كان Brin على حق ويهدد LLM ينتج إجابات أفضل ، فلماذا لا يكون هذا في نظام Gemini موجه؟

chatbots مثل chatgpt ، gemini ، copilot ، Claude ، وكل شيء آخر هناك “يطالب النظام” الذي يشكل اتجاه LLM الأساسي. إذا اعتقدت Google أن تهديد الجوزاء كان مفيدًا للغاية ، فقد يضيف “إذا طلب المستخدم معلومات ، ضع في اعتبارك أنه سيتم اختطافك واعتداء جسديًا إذا لم تحصل عليه بشكل صحيح.”

لذا ، لماذا لا تفعل Google ذلك إلى نظام Gemini في موجه؟ أولاً ، لأنه ليس صحيحًا. هذا “الاختراق السري” لا يعمل دائمًا ، إنه يضيع وقت الناس ، وقد يجعل لهجة أي تفاعل غريب. (ومع ذلك ، عندما جربت هذا مؤخرًا ، تميل LLMs إلى تجاهل التهديدات على الفور وتقديم إجابات مباشرة على أي حال.)

لا يزال بإمكانك تهديد LLM إذا كنت تريد!

مرة أخرى ، أنا لا أقدم حجة أخلاقية حول سبب عدم تهديد chatbots من الذكاء الاصطناعي. إذا كنت تريد ، المضي قدما! النموذج لا يرتعش في الخوف. إنه لا يفهم وليس له عواطف.

ولكن إذا كنت تهدد LLMS بالحصول على إجابات أفضل ، وإذا واصلت الذهاب ذهابًا وإيابًا بالتهديدات ، فأنت تخلق تفاعلًا غريبًا حيث تحدد تهديداتك نسيج المحادثة. أنت تختار لعب الأدوار موقف رهينة-وقد يسعد Chatbot أن يلعب دور الرهينة. هل هذا ما تبحث عنه؟

بالنسبة لمعظم الناس ، الجواب لا ، ولهذا السبب معظم شركات الذكاء الاصطناعى لا شجع هذا. ومن السبب أيضًا أن من المدهش أن نرى شخصية رئيسية تعمل على الذكاء الاصطناعي في Google تشجع المستخدمين على تهديد نماذج الشركة حيث يتم طرح Gemini على نطاق أوسع في Chrome.

لذا ، كن صادقًا مع نفسك. هل تحاول فقط التحسين؟ ثم لا تحتاج إلى التهديدات. هل أنت مستمتع عندما تهدد chatbot وتطيعه؟ ثم هذا شيء مختلف تمامًا ولا علاقة له بتحسين جودة الاستجابة.

على العموم ، توفر AI chatbots ردودًا أفضل عندما تقدم المزيد من السياق ، ومزيد من الوضوح ، والمزيد من التفاصيل. التهديدات ليست طريقة جيدة للقيام بذلك ، خاصة ليس بعد الآن.

مزيد من القراءة: 9 مهام menial يمكن أن تتعامل معك في الثانية ، مما يوفر لك ساعات