أحدث اتجاه من الذكاء الاصطناعي هو أمر مضحك ، حيث اكتشف المستخدم أنه يمكنك توصيل عبارة مكياج في Google وإلحاقها بـ “المعنى” ، فإن ميزة نظرة عامة على Google من Google ستعمل على الهلوس للعبارة.

بدأ المؤرخ جريج جينر هذا الاتجاه مع منشور على بلوزكي الذي طلب فيه من Google شرح معنى “لا يمكنك لعق غرير مرتين”. أوضحت نظرة عامة على الذكاء الاصطناعي بشكل مفيد أن هذا التعبير يعني أنه لا يمكنك خداع شخص ما مرة ثانية بعد أن تم خداعه بالفعل مرة واحدة – وهو ما يبدو أنه تفسير معقول ، لكنه يتجاهل حقيقة أن هذا التعبير لم يكن موجودًا قبل أن يكون هذا الاستعلام فيروسيًا.

منذ ذلك الحين ، كان الناس يستمتعون بالكثير من المرح في الحصول على نظرة عامة على الذكاء الاصطناعي لشرح التعبيرات مثل “الحبار في إناء أي مريض” (وهذا يعني أن شيئًا ما خارج بيئته الطبيعية لن يكون قادرًا على التسبب في ضرر ، أو “يمكنك أن تأخذ كلبك إلى الشاطئ ولكن لا يمكنك الإبحار إلى سويسرا” (والتي هي ، وفقًا لعموم AI Overview ، وهي عبارة مستقيمة بشكل عادل مع الجليدات الدولية.

إنه لا يعمل لجميع الحالات ، لأن بعض العبارات لا تعيد نتائج نظرة عامة على الذكاء الاصطناعي. قال العالم المعرفي غاري ماركوس: “إنه غير متناسق إلى حد كبير” سلكية، “وهذا ما تتوقعه من Genai.”

يشير جينر إلى أنه مسلية كما هو ، فهو يشير إلى بعض المزالق للاعتماد بشدة على مصادر منظمة العفو الدولية التي تم إنشاؤها مثل نظرة عامة على AI للحصول على المعلومات. وكتب جينر: “إنها علامة تحذير على أن إحدى الوظائف الرئيسية لـ Googling – القدرة على التحقق من الاقتباس أو التحقق من مصدر أو تعقب شيء ما يتذكره نصف – ستصبح أكثر صعوبة إذا كانت الذكاء الاصطناعي تفضل إمكانيات إحصائية مشروعة على الحقيقة الفعلية”.

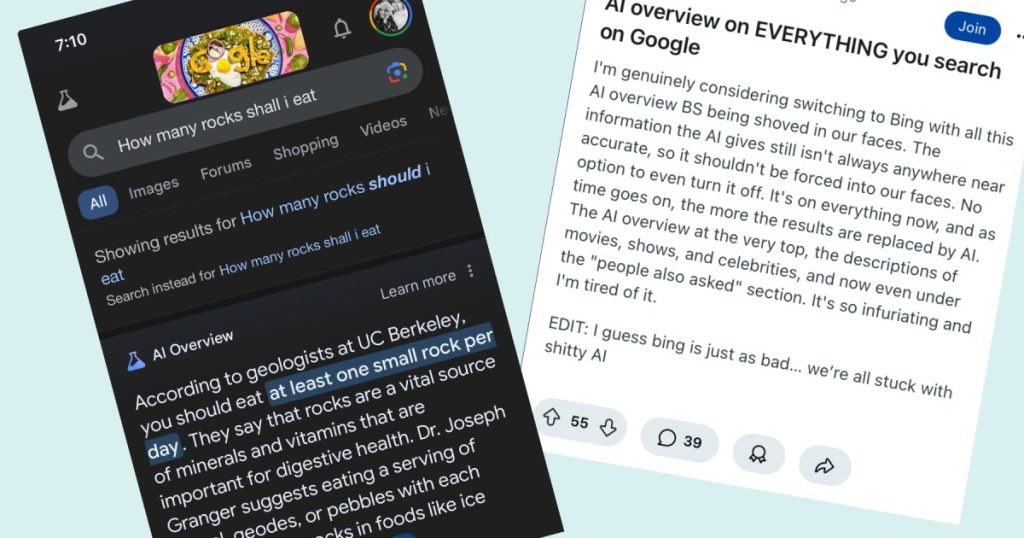

ليست هذه هي المرة الأولى التي يشير فيها الناس إلى قيود المعلومات التي يقدمها الذكاء الاصطناعى ، ونظرة عامة على الذكاء الاصطناعي على وجه الخصوص. عندما تم إطلاق نظرة عامة على الذكاء الاصطناعى ، اقترحت بشكل سيء أن يأكل الناس صخرة صغيرة يوميًا وأنهم يمكن أن يضعوا الغراء على البيتزا الخاصة بهم ، على الرغم من إزالة هذه الإجابات الخاصة بسرعة.

منذ ذلك الحين ، قالت Google في بيان للاتجاهات الرقمية إن غالبية نظرة عامة على الذكاء الاصطناعي توفر معلومات مفيدة وحقيقية ، وأنها لا تزال تجمع تعليقات على منتج AI.

في الوقت الحالي ، دع هذا بمثابة تذكير للتحقق من المعلومات التي تظهر في مربع نظرة عامة على الذكاء الاصطناعي في الجزء العلوي من نتائج Google ، حيث قد لا تكون دقيقة.