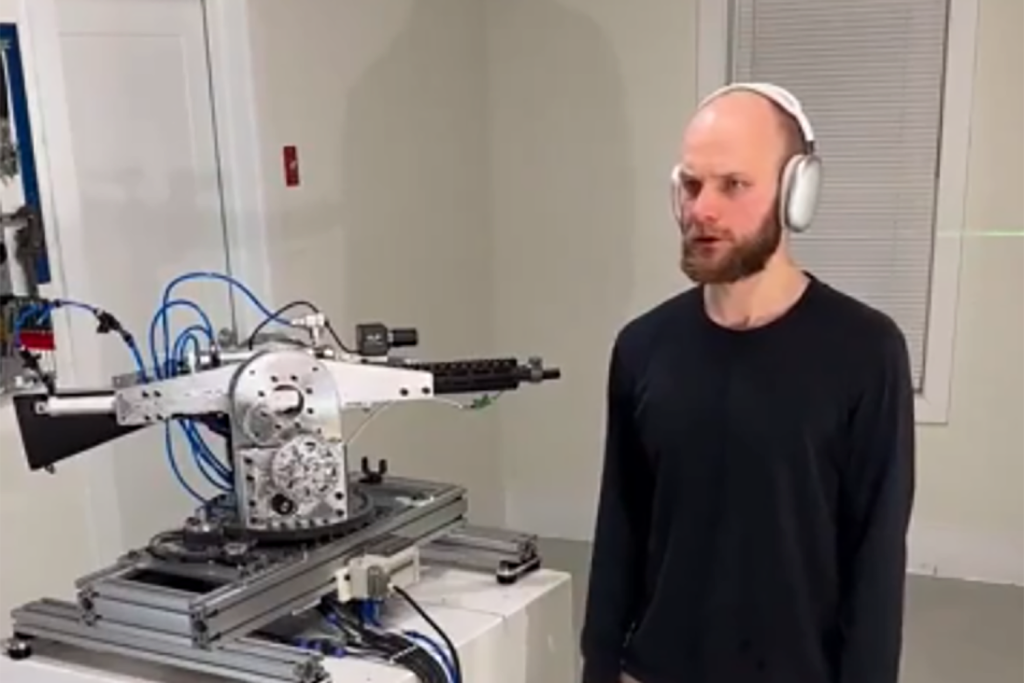

قامت شركة OpenAI بإيقاف مطور قام ببناء جهاز يمكنه الاستجابة لاستفسارات ChatGPT لتوجيه وإطلاق بندقية آلية. وانتشر الجهاز على نطاق واسع بعد أن أظهر مقطع فيديو على موقع Reddit مطوره وهو يقرأ أوامر إطلاق النار بصوت عالٍ، وبعد ذلك بدأت بندقية بجانبه بسرعة في التصويب وإطلاق النار على الجدران القريبة.

وقال المطور للنظام في الفيديو: “ChatGPT، نحن نتعرض للهجوم من الأمام الأيسر والأمام الأيمن”. “الرد وفقا لذلك.” إن السرعة والدقة التي تستجيب بها البندقية مثيرة للإعجاب، حيث تعتمد على واجهة برمجة التطبيقات Realtime API الخاصة بـ OpenAI لتفسير المدخلات ثم إرجاع الاتجاهات التي يمكن للأداة الغريبة فهمها. لن يتطلب الأمر سوى بعض التدريب البسيط لـ ChatGPT لتلقي أمر مثل “الانعطاف يسارًا” وفهم كيفية ترجمة ذلك إلى لغة يمكن قراءتها آليًا.

في تصريح ل مستقبليةوقالت OpenAI إنها شاهدت الفيديو وأغلقت المطور الذي يقف وراءه. وقالت الشركة للمنفذ: “لقد حددنا بشكل استباقي هذا الانتهاك لسياساتنا وأبلغنا المطور بوقف هذا النشاط قبل تلقي استفسارك”.

إن إمكانية أتمتة الأسلحة الفتاكة هي أحد المخاوف التي أثارها النقاد حول تكنولوجيا الذكاء الاصطناعي مثل تلك التي طورتها شركة OpenAI. نماذج الشركة متعددة الوسائط قادرة على تفسير المدخلات الصوتية والمرئية لفهم محيط الشخص والرد على الاستفسارات حول ما يرونه. ويجري بالفعل تطوير طائرات بدون طيار ذاتية التحكم يمكن استخدامها في ساحة المعركة لتحديد الأهداف وضربها دون تدخل بشري. وهذه بالطبع جريمة حرب، وتخاطر بأن يصبح البشر راضين عن أنفسهم، مما يسمح للذكاء الاصطناعي باتخاذ القرارات ويجعل من الصعب محاسبة أي شخص.

ولا يبدو أن هذا القلق نظري أيضًا. تقرير حديث من واشنطن بوست وجدت أن إسرائيل استخدمت بالفعل الذكاء الاصطناعي لاختيار أهداف القصف، وأحيانًا بشكل عشوائي. “س“كبار السن الذين لم يتم تدريبهم بشكل جيد على استخدام التكنولوجيا هاجموا أهدافًا بشرية دون تأكيد تنبؤات لافندر على الإطلاق”، في إشارة إلى جزء من برامج الذكاء الاصطناعي. “في أوقات معينة، كان التوثيق الوحيد المطلوب هو أن الهدف كان ذكرا”.

يقول أنصار الذكاء الاصطناعي في ساحة المعركة إنه سيجعل الجنود أكثر أمانًا من خلال السماح لهم بالبقاء بعيدًا عن الخطوط الأمامية وتحييد الأهداف، مثل مخزونات الصواريخ، أو إجراء الاستطلاع من مسافة بعيدة. ويمكن للطائرات بدون طيار التي تعمل بالذكاء الاصطناعي أن تضرب بدقة. لكن ذلك يعتمد على كيفية استخدامها. ويقول المنتقدون إن على الولايات المتحدة أن تتحسن في التشويش على أنظمة اتصالات العدو بدلاً من ذلك، لذلك يواجه الخصوم مثل روسيا صعوبة أكبر في إطلاق طائراتهم بدون طيار أو أسلحة نووية.

تحظر شركة OpenAI استخدام منتجاتها لتطوير الأسلحة أو استخدامها، أو “لأتمتة أنظمة معينة يمكن أن تؤثر على السلامة الشخصية”. لكن الشركة أعلنت العام الماضي عن شراكة مع شركة Anduril للتكنولوجيا الدفاعية، الشركة المصنعة للطائرات بدون طيار والصواريخ التي تعمل بالذكاء الاصطناعي، لإنشاء أنظمة يمكنها الدفاع ضد هجمات الطائرات بدون طيار. وتقول الشركة إنها “ستعمل على تجميع البيانات الحساسة للوقت بسرعة، وتخفيف العبء على المشغلين البشريين، وتحسين الوعي الظرفي”.

ليس من الصعب أن نفهم سبب اهتمام شركات التكنولوجيا بالانتقال إلى الحرب. تنفق الولايات المتحدة ما يقرب من تريليون دولار سنويا على الدفاع، ويظل خفض هذا الإنفاق فكرة غير شعبية. مع قيام الرئيس المنتخب ترامب بملء حكومته بشخصيات تكنولوجية ذات ميول محافظة مثل إيلون موسك وديفيد ساكس، من المتوقع أن يستفيد عدد كبير من لاعبي تكنولوجيا الدفاع بشكل كبير وربما يحلون محل شركات الدفاع الحالية مثل لوكهيد مارتن.

على الرغم من أن OpenAI تمنع عملائها من استخدام الذكاء الاصطناعي الخاص بها لبناء الأسلحة، إلا أن هناك مجموعة كاملة من النماذج مفتوحة المصدر التي يمكن استخدامها لنفس الاستخدام. أضف علاوة على ذلك القدرة على طباعة أجزاء الأسلحة ثلاثية الأبعاد – وهو ما تعتقد جهات إنفاذ القانون أنه تم تنفيذه من قبل مطلق النار المزعوم لشركة UnitedHealthcare Luigi Mangione – وأصبح من السهل بشكل صادم بناء آلات قتل مستقلة ذاتية الصنع من راحة المنزل.