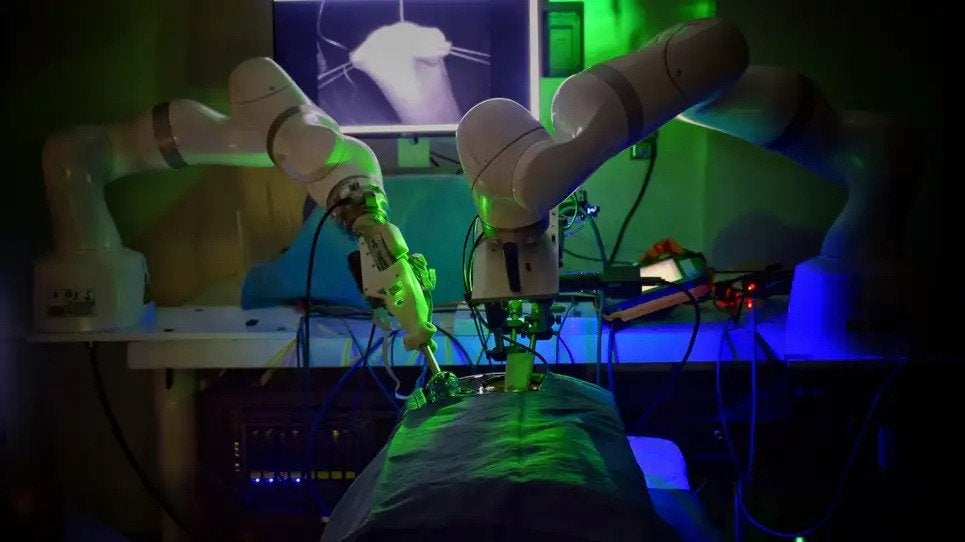

لقد بدأت طفرة الذكاء الاصطناعي بالفعل في التسلل إلى المجال الطبي من خلال شكل ملخصات الزيارات المستندة إلى الذكاء الاصطناعي وتحليل حالات المرضى. الآن، يوضح بحث جديد كيف يمكن استخدام تقنيات تدريب الذكاء الاصطناعي المشابهة لتلك المستخدمة في ChatGPT لتدريب الروبوتات الجراحية على العمل بمفردها.

قام باحثون من جامعة جون هوبكنز وجامعة ستانفورد ببناء نموذج تدريبي باستخدام تسجيلات فيديو لأذرع آلية يتحكم فيها الإنسان وتقوم بمهام جراحية. من خلال تعلم تقليد الحركات على الفيديو، يعتقد الباحثون أن بإمكانهم تقليل الحاجة إلى برمجة كل حركة فردية مطلوبة لإجراء ما. من واشنطن بوست:

تعلمت الروبوتات كيفية التعامل مع الإبر وربط العقد وخياطة الجروح بمفردها. علاوة على ذلك، ذهبت الروبوتات المدربة إلى ما هو أبعد من مجرد التقليد، فقامت بتصحيح أخطائها دون أن يُطلب منها ذلك ــ على سبيل المثال، التقاط إبرة سقطت. لقد بدأ العلماء بالفعل المرحلة التالية من العمل: الجمع بين جميع المهارات المختلفة في العمليات الجراحية الكاملة التي يتم إجراؤها على جثث الحيوانات.

من المؤكد أنه تم استخدام الروبوتات في غرفة الجراحة لسنوات حتى الآن – في عام 2018، سلطت عبارة “الجراحة على العنب” الضوء على كيف يمكن للأذرع الآلية أن تساعد في العمليات الجراحية من خلال توفير مستوى عالٍ من الدقة. تم إجراء ما يقرب من 876 ألف عملية جراحية بمساعدة الروبوت في عام 2020. ويمكن للأدوات الروبوتية الوصول إلى أماكن وأداء مهام في الجسم لا تناسبها يد الجراح أبدًا، ولا يعانون من الهزات. يمكن للأدوات الرفيعة والدقيقة أن تتجنب تلف الأعصاب. لكن يتم توجيه الروبوتات يدويًا بواسطة جراح مزود بوحدة تحكم. الجراح هو المسؤول دائما.

وما يقلق المتشككين في الروبوتات الأكثر استقلالية هو أن نماذج الذكاء الاصطناعي مثل ChatGPT ليست “ذكية”، بل تحاكي ببساطة ما رأوه من قبل، ولا تفهم المفاهيم الأساسية التي تتعامل معها. إن التنوع اللامحدود للأمراض في مجموعة لا حصر لها من العوائل البشرية يشكل تحديًا، إذن، ماذا لو لم يشهد نموذج الذكاء الاصطناعي سيناريو محددًا من قبل؟ يمكن أن يحدث خطأ ما أثناء الجراحة في جزء من الثانية، وماذا لو لم يتم تدريب الذكاء الاصطناعي على الاستجابة؟

على أقل تقدير، ستحتاج الروبوتات المستقلة المستخدمة في العمليات الجراحية إلى موافقة إدارة الغذاء والدواء. وفي الحالات الأخرى التي يستخدم فيها الأطباء الذكاء الاصطناعي لتلخيص زياراتهم للمرضى وتقديم التوصيات، لا تكون موافقة إدارة الغذاء والدواء مطلوبة لأنه من المفترض تقنيًا أن يقوم الطبيب بمراجعة أي معلومات يقدمونها والمصادقة عليها. وهذا أمر مثير للقلق لأن هناك بالفعل أدلة على أن روبوتات الذكاء الاصطناعي ستقدم توصيات سيئة، أو تهلوس وتدرج معلومات في نصوص الاجتماعات لم يتم نطقها مطلقًا. كم مرة يقوم طبيب متعب ومرهق بالموافقة على كل ما ينتجه الذكاء الاصطناعي دون فحصه عن كثب؟

إنه يذكرنا بالتقارير الأخيرة المتعلقة بكيفية اعتماد الجنود في إسرائيل على الذكاء الاصطناعي لتحديد أهداف الهجوم دون التدقيق في المعلومات عن كثب. “الجنود الذين لم يتم تدريبهم بشكل جيد على استخدام التكنولوجيا هاجموا أهدافًا بشرية دون تأكيد تنبؤات (الذكاء الاصطناعي) على الإطلاق”. واشنطن بوست تقرأ القصة. “في أوقات معينة، كان التوثيق الوحيد المطلوب هو أن الهدف كان ذكرا”. يمكن أن تنحرف الأمور عندما يصبح البشر راضين عن أنفسهم ولا يتواجدون بشكل كافٍ في الحلقة.

تعتبر الرعاية الصحية مجالًا آخر ذو مخاطر عالية، وهي بالتأكيد أعلى من السوق الاستهلاكية. إذا قام Gmail بتلخيص رسالة بريد إلكتروني بشكل غير صحيح، فهذا ليس نهاية العالم. إن قيام أنظمة الذكاء الاصطناعي بتشخيص مشكلة صحية بشكل غير صحيح، أو ارتكاب خطأ أثناء الجراحة، يعد مشكلة أكثر خطورة بكثير. ومن المسؤول في هذه الحالة؟ ال بريد أجرى مقابلة مع مدير الجراحة الروبوتية في جامعة ميامي، وهذا ما قاله:

وقال: “إن المخاطر كبيرة للغاية، لأن هذه مسألة حياة أو موت”. يختلف تشريح كل مريض، وكذلك الطريقة التي يتصرف بها المرض لدى المرضى.

وقال باريخ: “إنني أنظر إلى (الصور من) الأشعة المقطعية والرنين المغناطيسي ثم أقوم بإجراء عملية جراحية” عن طريق التحكم في الأذرع الآلية. “إذا كنت تريد أن يقوم الروبوت بإجراء الجراحة بنفسه، فسيتعين عليه أن يفهم كل صور التصوير، وكيفية قراءة الأشعة المقطعية والرنين المغناطيسي.” بالإضافة إلى ذلك، ستحتاج الروبوتات إلى تعلم كيفية إجراء جراحة ثقب المفتاح، أو الجراحة التنظيرية، التي تستخدم شقوقًا صغيرة جدًا.

من الصعب أن نأخذ فكرة أن الذكاء الاصطناعي سيكون معصومًا من الخطأ على محمل الجد في ظل عدم وجود تكنولوجيا مثالية على الإطلاق. من المؤكد أن هذه التكنولوجيا المستقلة مثيرة للاهتمام من منظور بحثي، ولكن رد الفعل السلبي الناجم عن عملية جراحية فاشلة أجراها روبوت مستقل سيكون هائلا. من الذي تعاقبه عندما يحدث خطأ ما، ومن تم إلغاء رخصته الطبية؟ البشر ليسوا معصومين من الخطأ أيضًا، ولكن على الأقل يتمتع المرضى براحة البال عندما يعلمون أنهم مروا لسنوات من التدريب ويمكن محاسبتهم إذا حدث خطأ ما. إن نماذج الذكاء الاصطناعي عبارة عن محاكاة بدائية للبشر، وتتصرف في بعض الأحيان بشكل لا يمكن التنبؤ به، وليس لديها بوصلة أخلاقية.

إذا كان الأطباء متعبين ومرهقين بالعمل – وهو السبب الذي جعل الباحثين يقترحون لماذا يمكن أن تكون هذه التكنولوجيا ذات قيمة – فربما ينبغي معالجة المشاكل النظامية التي تسبب النقص بدلاً من ذلك. لقد تم الإبلاغ على نطاق واسع أن الولايات المتحدة تعاني من نقص حاد في الأطباء بسبب تزايد عدم إمكانية الوصول إلى هذا المجال. تسير البلاد على الطريق الصحيح لمواجهة نقص يتراوح بين 10000 إلى 20000 جراح بحلول عام 2036، وفقًا للجمعية الأمريكية لكليات الطب.