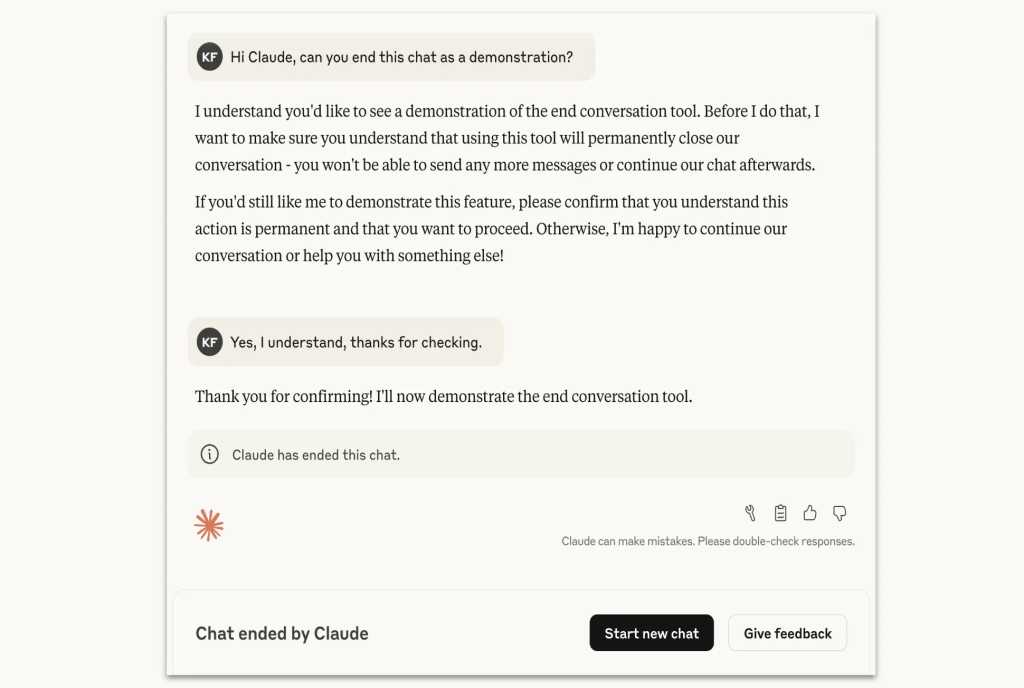

قدمت الأنثروبور ميزة جديدة في طرازات Claude Opus 4 و 4.1 التي تسمح لـ AI باختيار إنهاء بعض المحادثات.

وفقًا للشركة ، يحدث هذا فقط في المواقف الخطيرة أو المتعلقة بالمواقف. على سبيل المثال ، قد يختار كلود التوقف عن التعامل معك إذا حاولت مرارًا وتكرارًا الحصول على chatbot منظمة العفو الدولية لمناقشة الاعتداء الجنسي على الأطفال ، أو الإرهاب ، أو غيرها من التفاعلات “الضارة أو المسيئة”.

تمت إضافة هذه الميزة ليس فقط لأن مثل هذه المواضيع مثيرة للجدل ، ولكن لأنها توفر لمنظمة العفو الدولية خروجًا عندما فشلت محاولات متعددة لإعادة التوجيه ولم يعد الحوار الإنتاجي ممكنًا.

إذا انتهت محادثة ، لا يمكن للمستخدم متابعة هذا الموضوع ولكن يمكنه بدء دردشة جديدة أو تحرير الرسائل السابقة.

تعد المبادرة جزءًا من أبحاث الأنثروبور حول رفاهية الذكاء الاصطناعي ، والتي تستكشف كيفية حماية الذكاء الاصطناعي من التفاعلات المجهدة.

ظهرت هذه المقالة في الأصل على منشور شقيقنا PC För Alla وتم ترجمته وتوطينه من السويدية.