دفع الباحثون في جامعة ستانفورد 60 دولارًا لـ 1052 شخصًا لقراءة أول سطرين من الكتاب غاتسبي العظيم إلى التطبيق. بعد ذلك، طلب الذكاء الاصطناعي الذي يشبه كائنًا ثنائي الأبعاد من لعبة Final Fantasy من عصر SNES، من المشاركين أن يرووا قصة حياتهم. أجرى العلماء تلك المقابلات وقاموا بتحويلها إلى ذكاء اصطناعي يقولون إنه يكرر سلوك المشاركين بدقة تصل إلى 85%.

الدراسة بعنوان محاكاة الوكيل التوليدي لـ 1000 شخص، هو مشروع مشترك بين جامعة ستانفورد وعلماء يعملون في مختبر أبحاث DeepMind AI التابع لشركة Google. الفكرة هي أن إنشاء عملاء الذكاء الاصطناعي استنادًا إلى أشخاص عشوائيين يمكن أن يساعد صناع السياسات ورجال الأعمال على فهم الجمهور بشكل أفضل. لماذا تستخدم مجموعات التركيز أو تقوم باستطلاع آراء الجمهور عندما يمكنك التحدث إليهم مرة واحدة، وإعداد ماجستير في القانون بناءً على تلك المحادثة، ومن ثم الحصول على أفكارهم وآرائهم إلى الأبد؟ أو، على الأقل، أقرب ما يمكن من إعادة إنشاء هذه الأفكار والمشاعر.

وجاء في ملخص البحث أن “هذا العمل يوفر أساسًا لأدوات جديدة يمكن أن تساعد في التحقيق في السلوك الفردي والجماعي”.

“كيف يمكن، على سبيل المثال، أن تستجيب مجموعة متنوعة من الأفراد لسياسات ورسائل الصحة العامة الجديدة، أو الاستجابة لإطلاق المنتجات، أو الاستجابة للصدمات الكبرى؟” وتابعت الورقة. “عندما يتم دمج الأفراد الذين تمت محاكاتهم في مجموعات، يمكن أن تساعد عمليات المحاكاة هذه في التدخلات التجريبية، وتطوير نظريات معقدة تلتقط التفاعلات السببية والسياقية الدقيقة، وتوسيع فهمنا للهياكل مثل المؤسسات والشبكات عبر مجالات مثل الاقتصاد وعلم الاجتماع والمنظمات والعلوم السياسية. “

كل هذه الاحتمالات المستندة إلى مقابلة مدتها ساعتان تغذي رسالة LLM التي أجابت في الغالب على الأسئلة مثل نظيراتها في الحياة الواقعية.

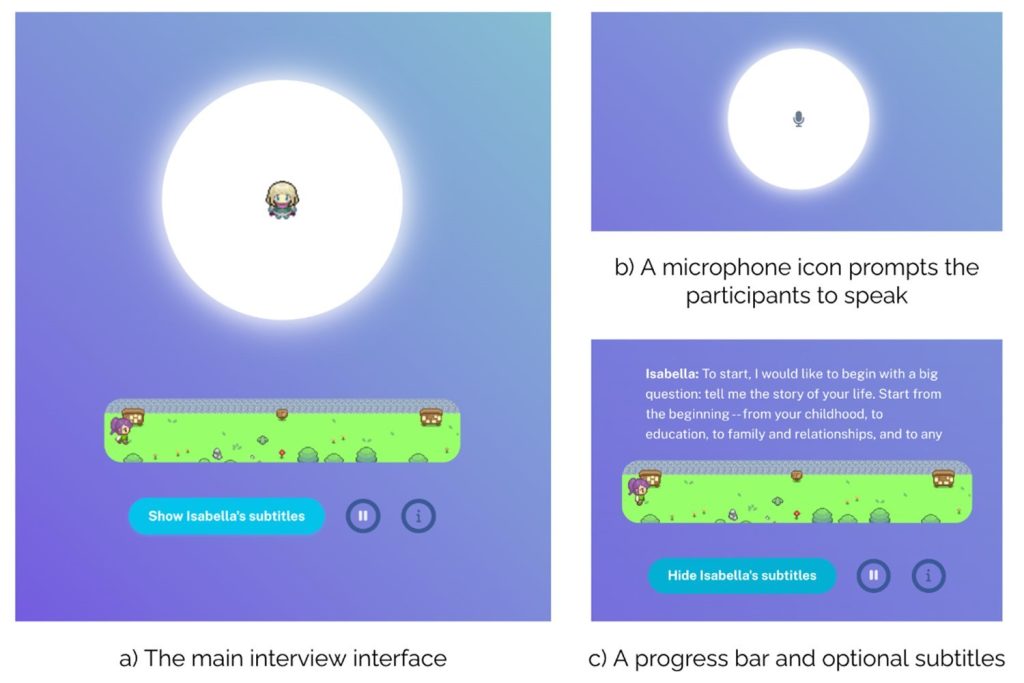

تمت أتمتة جزء كبير من العملية. تعاقد الباحثون مع شركة Bovitz، وهي شركة لأبحاث السوق، لجمع المشاركين. وكان الهدف هو الحصول على عينة واسعة من سكان الولايات المتحدة، على أوسع نطاق ممكن عندما يقتصر على 1000 شخص. لإكمال الدراسة، قام المستخدمون بالتسجيل للحصول على حساب في واجهة مخصصة لهذا الغرض، وقاموا بإنشاء صورة رمزية ثنائية الأبعاد، وبدأوا في التحدث إلى أحد القائمين على الذكاء الاصطناعي.

الأسئلة وأسلوب المقابلة هي نسخة معدلة من تلك التي يستخدمها مشروع الأصوات الأمريكية، وهو مشروع مشترك بين جامعة ستانفورد وبرينستون يجري مقابلات مع الناس في جميع أنحاء البلاد.

بدأت كل مقابلة بقراءة المشاركين للسطرين الأولين من القصة غاتسبي العظيم (“في سنوات شبابي وأكثر ضعفًا، أعطاني والدي بعض النصائح التي ظللت أقلبها في ذهني منذ ذلك الحين. قال لي: “كلما شعرت بالرغبة في انتقاد أي شخص، فقط تذكر أن كل الناس في هذا العالم لم يتمتع بالمزايا التي كنت تتمتع بها.'”) كوسيلة لمعايرة الصوت.

وفقًا للصحيفة، “عرضت واجهة المقابلة صورة رمزية ثنائية الأبعاد تمثل وكيل المقابلة في المركز، مع ظهور الصورة الرمزية للمشارك في الأسفل، وهو يسير نحو عمود الهدف للإشارة إلى التقدم. عندما كان وكيل المقابلة الذي يعمل بتقنية الذكاء الاصطناعي يتحدث، تم الإشارة إليه من خلال رسم متحرك نابض للدائرة المركزية مع الصورة الرمزية للشخص الذي يجري المقابلة.

أنتجت المقابلات التي استغرقت ساعتين، في المتوسط، نصوصًا بلغ طولها 6491 كلمة. وطرحت أسئلة حول العرق والجنس والسياسة والدخل واستخدام وسائل التواصل الاجتماعي والضغوط التي يتعرضون لها في وظائفهم وتكوين أسرهم. نشر الباحثون نص المقابلة والأسئلة التي طرحها الذكاء الاصطناعي.

تم بعد ذلك إدخال تلك النصوص، التي يقل كل منها عن 10000 كلمة، في ماجستير آخر استخدمه الباحثون لتدوير العوامل التوليدية التي تهدف إلى تكرار المشاركين. بعد ذلك، قام الباحثون بإخضاع المشاركين والمستنسخين من الذكاء الاصطناعي لمزيد من الأسئلة والألعاب الاقتصادية لمعرفة كيفية المقارنة بينهم. وقالت الصحيفة: “عندما يتم الاستعلام عن وكيل، يتم إدخال نص المقابلة بالكامل في نموذج المطالبة، وتوجيه النموذج لتقليد الشخص بناءً على بيانات المقابلة الخاصة به”.

كان هذا الجزء من العملية أقرب ما يكون إلى السيطرة عليه قدر الإمكان. استخدم الباحثون المسح الاجتماعي العام (GSS) وقائمة الشخصيات الخمس الكبرى (BFI) لاختبار مدى توافق ماجستير إدارة الأعمال مع إلهامهم. ثم قام بعد ذلك بإجراء المشاركين وحاملي شهادة الماجستير في القانون من خلال خمس ألعاب اقتصادية لمعرفة كيفية المقارنة بينهم.

وكانت النتائج مختلطة. أجاب عملاء الذكاء الاصطناعي على حوالي 85% من الأسئلة بنفس الطريقة التي أجاب بها المشاركون في العالم الحقيقي على GSS. لقد وصلوا إلى 80٪ على BFI. ومع ذلك، انخفضت الأرقام عندما بدأ العملاء في ممارسة الألعاب الاقتصادية. وقد عرض الباحثون على المشاركين في الحياة الواقعية جوائز نقدية للعب ألعاب مثل معضلة السجين ولعبة الدكتاتور.

في معضلة السجين، يمكن للمشاركين اختيار العمل معًا والنجاح أو الإطاحة بشريكهم للحصول على فرصة لتحقيق فوز كبير. في لعبة الدكتاتور، يتعين على المشاركين اختيار كيفية تخصيص الموارد للمشاركين الآخرين. حصل الأشخاص الواقعيون على أموال تزيد عن 60 دولارًا الأصليًا مقابل لعب هذه الألعاب.

في مواجهة هذه الألعاب الاقتصادية، لم تقم نسخ الذكاء الاصطناعي للبشر بتكرار نظيراتها في العالم الحقيقي أيضًا. “في المتوسط، حققت العوامل المولدة ارتباطًا طبيعيًا قدره 0.66″، أو حوالي 60%.

الوثيقة بأكملها تستحق القراءة إذا كنت مهتمًا بكيفية تفكير الأكاديميين بشأن عملاء الذكاء الاصطناعي والجمهور. لم يستغرق الباحثون وقتًا طويلاً حتى يلخصوا شخصية الإنسان في ماجستير في القانون يتصرف بشكل مماثل. ومع توفر الوقت والطاقة، فمن المحتمل أن يتمكنوا من التقريب بين الاثنين.

وهذا أمر مقلق بالنسبة لي. ليس لأنني لا أريد أن أرى الروح الإنسانية التي لا توصف وقد تحولت إلى جدول بيانات، ولكن لأنني أعرف أن هذا النوع من التكنولوجيا سيتم استخدامه في الشر. لقد رأينا بالفعل طلاب ماجستير في القانون أغبى مدربين على التسجيلات العامة وهم يخدعون الجدات لإعطاء معلومات مصرفية إلى أحد أقارب الذكاء الاصطناعي بعد مكالمة هاتفية سريعة. ماذا يحدث عندما يكون لهذه الآلات برنامج نصي؟ ماذا يحدث عندما يكون لديهم إمكانية الوصول إلى شخصيات محددة الغرض بناءً على نشاط وسائل التواصل الاجتماعي وغيرها من المعلومات المتاحة للجمهور؟

ماذا يحدث عندما تقرر شركة أو سياسي أن الجمهور يريد ويحتاج إلى شيء ما بناءً على إرادتهم المنطوقة، ولكن على أساس تقريبي لها؟